1、“偷”用户内容训练AI模型,“版权卫士”Adobe作茧自缚

今年2月,Adobe悄悄更新了产品服务条款。其中一项条款要求用户同意Adobe可以“通过自动和手动的方式”访问用户作品,包括受保密协议(NDA)保护的内容,并使用“机器学习等技术来改进Adobe的服务和软件”。如果用户拒绝接受新条款,则无法正常使用Adobe的软件。这一条款调整近期遭到曝光,引发了创意人士、数字艺术家和设计师等Adobe主力用户发文抵制。他们认为该条款实质上是一种强制授权,无异于“霸王条款”,目的是训练Adobe旗下的生成式AI模型“Firefly”。X博主“Sam Santala”在6月初发布的一条质疑该条款的推文,目前浏览量已达千万。许多用户在社交媒体上表示,出于对隐私和版权的担忧,他们选择停止使用Adobe的产品。该不满最初并未引起Adobe官方的重视,仅称这些条款已存在多年,然而随着争议的加剧,Adobe于6月19日修订了服务条款,明确表示不会使用用户存储在本地或云端的内容来训练AI模型。但这一澄清并未完全平息创作者的担忧。海外AI圈知名博主“Bilawal Sidhu”指出,Adobe的修订版服务条款仍允许使用用户私有云数据训练非生成式AI工具的机器学习模型。(来源:AI新榜)

评论:在大模型遵循Scaling law这一基本原则的当下,随着模型规模的增加,其性能和效率也会显著增加。正因此,各开发者纷纷寻找新的训练资料来源,网络平台的用户内容变成了具有无限魔力的宝藏。2023年,国内便有两家平台先后修改用户协议表明将对用户上传的文档材料等内容采取脱敏后作为AI训练的基础材料使用。今年6月,社交媒体平台Meta宣布将使用Facebook 和 Instagram上的公开内容来训练大模型,包括互动内容、状态、照片和标题等。前述事件无一例外均引起了很大的舆论风波,最终相关平台不得不修改协议或暂停相关计划。

实际上,我国对于使用用户内容进行训练已有相关规范,《生成式人工智能服务安全基本要求》在安全措施方面明确提出“c)当收集使用者输入信息用于训练时:1)应为使用者提供关闭其输入信息用于训练的方式,例如为使用者提供选项或语音控制指令;关闭方式应便捷,例如采用选项方式时使用者从服务主界面开始到达该选项所需操作不超过4次点击”。但根据相关法律从业者研究表明(可参见新江湾的周日《如何合规地用用户输入信息进行训练》),目前仅有豆包告知了用户关闭/拒绝的方式,该等规范要求尚未完全落地。

此外,从北京互联网法院在AI声音权第一案透露出的态度来看,目前司法实践中更倾向于将AI训练权作为一项《著作权法》项下的其他未规定权利。因此,如果平台只是笼统在用户协议表示为实现产品目的,或为了宣传或介绍用户内容等目的,会获得用户的相应授权,该等授权不应视为用户允许平台将其内容进行AI训练。如发生争议,仅凭这些笼统授权条款将很难作为使用用户内容进行训练的正当性依据。

2023年3月,Adobe推出了Firefly模型,强调其模型训练数据的合法性,并承诺对使用Firefly生成的图片引发的版权纠纷支付索赔,其像是AI界的“版权卫士”。而时隔一年,Adobe又因Firefly模型训练问题陷入舆论危机。这种反差也正说明,人工智能训练合规可能还有很长的路要走。

2、AI搜索平台Perplexity被指责抄袭和侵权

近日,多家出版商和媒体机构指控Perplexity未经授权将网站的内容和信息用于AI生成的摘要、报告和“Perplexity Pages”产品中。数字内容协会(Digital Content Next,其成员包括《纽约时报》《华盛顿邮报》和 Condé Nast)和美国新闻媒体联盟(News Media Alliance)等行业组织对Perplexity的行为表示担忧。6月28日,亚马逊的云部门也已经对Perplexity AI展开了其是否违反亚马逊网络服务规则的调查。Perplexity 已被发现使用与公司未公开关联的IP地址来抓取受限制的内容,使网站所有者难以阻止这些活动。Perplexity CEO还承认曾通过伪装成学术研究人员的方式来获取Twitter数据。根据媒体报道,Perplexity“窃取”网站内容和流量涉及多种方法,其中包括:未经许可抓取受限内容、未能在汇总中充分引用信息原始来源、绕过付费墙获取付费内容、模拟真实用户进行抓取。(来源:绮丽小船)

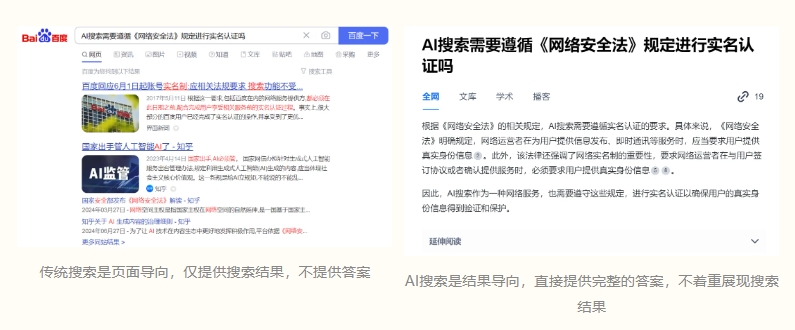

评论:AI搜索与传统搜索存在较大不同,在AI搜索模式下,用户在平台内以聊天的形式输入信息,AI工具理解用户查询背后的意图和上下文,过滤掉低质、无关信息,生成高度相关的且个性化的答案,提高了用户的搜索效率和结果的准确性。但是从展现模式上,用户可以在AI搜索页面看到其希望搜索的完整信息,用户也无需再点击相关链接进行查看,即这种商业模式下用户无须实施跳转行为,搜索引擎与其他网站之间并非流量协作关系,而更像相互替代的关系,这就引发了不正当竞争的疑问。

今年1月,《纽约时报》起诉OpeanAI及微软公司,起诉文件中的理由之一就是基于大型语言模型构建的合成搜索应用程序,其合成输出显示的文章内容更具有表现力,且部分结果未经授权将《纽约时报》作品逐字逐句复制并输出,这种方式将本应该属于《纽约时报》等版权人的流量转移到合成搜索应用之上,涉嫌构成不正当竞争行为。此前在上海某信息咨询有限公司与北京某网讯科技有限公司等不正当竞争纠纷案中,人民法院认定未经许可大量完整使用用户点评信息达到实质替代程度的行为明显造成对同业竞争者的损害,属于不正当竞争。结合《反不正当竞争法》第十二条“妨碍、干扰产品正常运行”的规定及《网络反不正当竞争暂行规定》第二十六条规定“判定构成妨碍、破坏其他经营者合法提供的网络产品或者服务正常运行,可以综合考虑下列因素:(四)其他经营者合法提供的网络产品或者服务的用户或者访问量是否不合理减少”。该等司法实践及法律规定均说明,AI搜索产品在提升用户使用效率的同时也带来了与其他竞争者之间的利益失衡,可能蕴含着巨大的法律风险。AI搜索的业务形态最终将如何合规塑造,让我们共同期待行业及司法的回应。

3、人工智能产业迎利好!四部门发文建设标准化体系

7月3日,工业和信息化部、中央网信办、国家发展改革委、国家标准委等四部门近日联合印发《国家人工智能产业综合标准化体系建设指南(2024版)》。伴随以大模型为代表的新技术加速迭代,人工智能产业呈现出创新技术群体突破、行业应用融合发展、国际合作深度协同等新特点,亟需完善人工智能产业标准体系。到2026年,标准与产业科技创新的联动水平持续提升,新制定国家标准和行业标准50项以上,引领人工智能产业高质量发展的标准体系加快形成。开展标准宣贯和实施推广的企业超过1000家,标准服务企业创新发展的成效更加凸显。参与制定国际标准20项以上,促进人工智能产业全球化发展。(来源:中国政府网)

评论:由于AI技术的发展太过迅猛,截至目前我国尚未出台《人工智能法》,虽然《国务院2024年度立法工作计划》将“人工智能法草案”再次列入预备提请全国人大常委会审议项目,但其最终出台尚需很长时间。因此,当前我国AI行业的监管是以行政监管为主线,国家标准、行业标准、技术标准为支撑,同时鼓励行业自律和社会监督相结合的多元化监管体系。国家标准、行业标准、技术标准作为监管的重要基础,为AI产品的安全性、可靠性和伦理合规性设立了统一的衡量标尺。本次人工智能产业综合标准化体系建设指南正为AI行业的后续发展提供支撑,这也解释了全国网安标委为何在同日公布了《网络安全技术 人工智能生成合成内容标识方法》国家标准计划。预计后续针对AI技术的特定领域,如自动驾驶、医疗健康、金融科技等,也将制定更为细致的指导原则和管理细则。

4、过去十年中国生成式AI专利申请量居全球第一

7月3日,世界知识产权组织发布《生成式人工智能专利态势报告》。报告显示,2014年至2023年,中国发明人申请的生成式人工智能专利数量最多,远超美国、韩国、日本和印度等国。2014年至2023年,全球生成式人工智能相关的发明申请量达54000件,其中超过25%是在去年一年出现的。生成式人工智能允许用户创建文本、图像、音乐和计算机代码等内容,为一系列工业和消费产品提供动力。2014年至2023年间,中国的生成式人工智能发明超过3.8万件,是排名第二的美国的6倍。(来源:央视新闻)

评论:从事知识产权的人士都清楚,仅凭专利数量并不能全面代表一个国家行业发展的高水平。专利质量、实际应用、商业化程度以及对全球经济与社会的影响等因素也同样重要。但无论如何,中国AI技术专利数量的遥遥领先,至少意味着我国的企业和个人在积极进行新技术和新产品的研发,这是行业活力和技术创新的正面积极信号。

而从个人观点来看,更希望AI行业能够更加主动的推进开源模式。开源文化鼓励“站在巨人肩膀上”的精神,让开发者能够快速借鉴前人的工作,避免重复造轮子,从而有更多精力投入到更高层次的创新中去。这种“继承与发展”的模式,特别适合AI这样高度依赖数据积累和算法优化的领域。正如王怀民院士在腾讯网的报道中指出的,“开源已不仅是一种目的,而是一种推动技术创新发展的手段”。希望AI行业企业可以选择在关键技术上申请专利,而在其他非核心技术上选择开源,以此来平衡保护技术秘密和推动技术发展的需要。

- 相关领域

- 高科技与人工智能