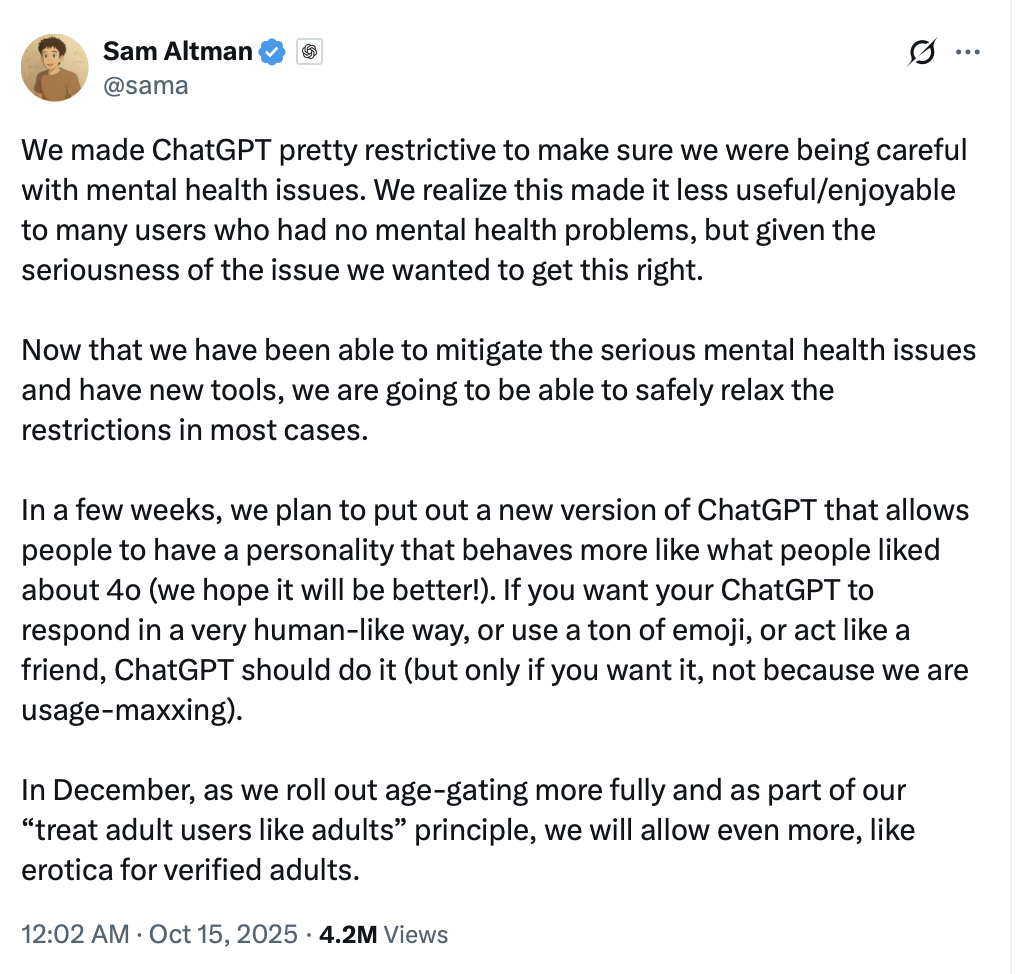

1、OpenAI称ChatGPT将开始向通过年龄验证的用户提供成人内容

10月15日,OpenAI首席执行官萨姆·奥特曼宣布,自12月起,该公司将允许ChatGPT用户在平台上进行年龄验证,并为其提供成熟内容。奥特曼在周二发布于X平台的一篇帖子中称:“随着年龄限制机制的全面推行,作为‘像对待成年人一样对待成人用户’原则的一部分,我们将放宽内容限制,为通过验证的成年用户提供成人内容。”(来源:新榜)

评论:难以想象OpenAI正面临着多大的营收压力,竟饥不择食地将成人内容视作商业上的救命稻草。这种策略在法律上风险巨大。年龄验证在全球范围内存在法律和技术鸿沟,不同法域对成人内容的界定、对年龄验证的手段要求区别很大,一个有效的年龄验证系统在实践中的难度是非常大的,这为未成年人接触不当内容留下了巨大缺口。一旦未成年人轻易绕过验证,接触到不当内容,OpenAI将立刻陷入儿童保护、内容监管的诉讼泥潭。

更核心的风险在于,ChatGPT是内容的生成者,而非仅仅是发布平台。这意味着OpenAI可能被认定为成人内容的直接出版者,承担最严格的法律责任。当AI生成的成人内容越过合法与非法的界线时,例如,涉及虚拟儿童色情或其他违禁主题,OpenAI可能将无法免责。这种主动提供成人内容的行为,不仅将使其苦心经营的人类AI助手品牌形象毁于一旦,更可能引来各国监管机构的严厉制裁,甚至触发刑事风险。我们不禁要问,一个连基本价值观都摇摆不定的公司,如何引领人类走向通用人工智能的未来?

2、美国加州签署全美首个AI陪聊机器人法案

10月13日消息,美国加利福尼亚州州长加文・纽森(Gavin Newsom)周一签署了一项具有里程碑意义的法案,对人工智能(AI)陪伴型聊天机器人进行监管,使加州成为全美首个要求AI聊天机器人运营商实施安全防护措施的州。

这项名为《参议院第243号法案》(SB 243)的法律旨在保护儿童和弱势用户免受AI陪伴聊天机器人使用过程中可能带来的伤害。根据该法案,从Meta、OpenAI等大型科技实验室,到Character AI、Replika等专注于陪伴功能的初创企业,若其聊天机器人未能达到法律规定的标准,将承担法律责任。(来源:人工智能与数据法律实务)

评论:SB 243法案背景是美国社会对AI聊天机器人可能带来的负面影响日益增长的担忧,包括数起与青少年自杀相关的悲剧事件。该法案试图保护儿童及弱势用户在使用此类AI应用时免受潜在伤害,并将于2026年1月1日正式生效。其适用范围广泛,涵盖了从Meta、OpenAI等大型科技公司,到Character AI、Replika等专注于AI伴侣功能的初创企业。法案的核心规定包括:运营商明确告知用户,他们正在与AI而非真人进行互动。对未成年人用户要发送定时提醒;运营商应防止有害内容的生成与传播,包括自杀与自残内容干预、色情内容等;要求运营商必须在其官方网站上公布用于防止自杀和自残内容生成的具体协议细节;运营商需要向加州公共卫生部共享相关数据;运营商实施年龄验证功能,作为保护未成年人的基础措施之一;该法案为用户提供维护自身权益的渠道,允许受害者对不合规或存在过失的运营商提起诉讼。

从实操视角来看,如何定义陪伴型AI都是一个实践难题。该法案中诸如“有效年龄验证”“防止有害内容”等要求,不仅在技术上难以实现,在法律上的定义也非常模糊,无异于为企业预设了严格法律责任。而且该法案赋予私人诉讼权,一旦生效,加州法院恐将成为“AI维权”诉讼的重灾区,这将为AI企业,特别是资源有限的初创公司,带来毁灭性的诉讼成本与合规压力。更具讽刺意味的是,法案强制运营商公布防止自杀等内容的具体协议,这种开卷考试式的监管,不仅无法根除风险,反而可能启发恶意用户研究并绕过这些机制。

我们理解SB 243法案的美好立法愿景,但在实操上可能存在诸多的问题及争议,其最终结果可能不是真正保护了儿童,而是扼杀了技术创新的活力,同时催生出一个以AI企业为目标的诉讼产业。在这场监管大戏中,最大的赢家,或许只有那些早已摩拳擦掌的律师们。

3、Grok造谣在德国遭禁言令

Campact e.V.成立于2004年,是德国最具影响力的公共倡议型非营利组织之一,Campact的运作资金主要来自个人捐赠,不接受政府补助或企业资助。近期,一名用户在社交平台X(原Twitter)上向AI聊天机器人Grok提问,询问Campact的资金来源。Grok回答称“Campact e.V.由纳税人资助”,并声称“引用了相关来源”。Campact认为这一说法完全不实,损害了其公信力,因此向运营商X.AI发送律师函并申请司法禁令。

汉堡地方法院受理此案(案号324 O 461/25),作出临时禁令,禁止X.AI继续发布该虚假陈述。法院明确指出,Grok的回答构成不真实的事实陈述,并认定X.AI应对此直接承担责任。

若该聊天机器人再次重复此类说法,法院可对公司处以最高25万欧元的秩序罚款。目前,X.AI仍可对该裁定提出异议。(来源:数据何规)

评论:AI生成内容的幻觉问题已经从一个技术性难题,变成了法律性难题。随着德国法院对Grok下达临时禁令,AI服务商们“模型犯错,用户负责”的商业模式,恐怕要提前终结了。

汉堡法院的本次禁令之所以在行业内引发关注,是因为它直接绕过了复杂的算法归因,简单粗暴的将X.AI认定为虚假信息的发布者,并课以直接责任。这种结果归责的裁判思路,对整个行业而言是致命的,它意味着无论你的免责声明写得多么详实完整,只要AI的输出构成了法律所禁止的侵权行为(如诽谤、造谣),服务商就必须为此买单。这显然是所有AI服务商都不愿看到的局面。但所幸目前仅是一项单独禁令,X.AI公司在正式诉讼中将有机会在实体判决上争取对自身有利的结果,或者利用案外契机进行和解。但对AI服务商来说,这次禁令可能都会留下一道长期的思考题:如果AI幻觉在技术上无法避免,如何设计产品的合规模型使其能最大限度上降低或免除因此产生的侵权责任?

4、苹果AI再陷集体诉讼

据科技媒体Appleinsider报道,美国纽约州立大学健康科学大学的两名学术作者苏珊娜・马丁内斯-康德与斯蒂芬・麦克尼克,近日以版权侵权为由对苹果公司提起集体诉讼,指控其“苹果智能”(Apple Intelligence)AI系统在训练过程中,非法使用包含两人著作盗版内容的数据库。

此次诉讼的核心争议焦点,集中在苹果公司AI训练所涉数据来源。原告方指出,苹果在未获得授权的情况下,利用包含其两部著作《幻觉冠军》(Champions of Illusion)与《思维的诡计》(Sleights of Mind)盗版内容的“Books3”数据库,用于“苹果智能”AI系统训练,此举已涉嫌侵犯其著作权。(来源:环球tech)

评论:苹果公司为了推出AI系统可谓艰难重重,前后引起了多个诉讼案件,2025年9月美国作家格雷迪・亨德里克斯和詹妮弗・罗伯逊向加州北区法院提起集体诉讼,指控苹果公司未经授权使用其作品训练大型语言模型OpenELM。本次诉讼的侵权源头依然是Books3数据库。这不仅暴露了苹果在AI竞赛中的焦虑,更揭示了当前生成式AI行业普遍存在的原罪问题,即对训练数据来源的法律尽职调查严重不足。

从法律角度看,这类案件的核心并非是技术能否合理使用,而是溯源到了一个更基础的问题:训练数据的获取是否从源头上就存在合法性瑕疵。Books3这类知名的盗版数据库,本身就是大规模侵权的产物。苹果即便想援引合理使用进行抗辩,其难度也远高于来源清晰的数据。其行为很可能被定性为在明知或应知数据为盗版的情况下,依然进行利用,这无疑加重了其侵权的主观恶意。

苹果作为生成式AI领域的追赶者,其急于求成的心态可以理解,但其对数据合规的漠视,尤其是对Books3这类盗版数据集的依赖,则显得尤为不明智。毕竟,苹果公司向来以法务合规与注重隐私著称,被视为科技界的模范生。这一连串的诉讼,与其说是苹果一家的法律困境,不如说是整个AI行业数据原罪的集中爆发。所有的大模型公司都可能要面临着近期内大量的权利人维权诉讼,幻想通过技术优势绕过基础的法律问题,最终只会被法律本身所反噬。

- 相关领域

- 高科技与人工智能