1、Anthropic指控三家中国模型非法蒸馏

2026年2月24日,美国人工智能企业Anthropic在其官网公开发文,指控DeepSeek等三家中国大模型企业试图通过“蒸馏”技术(即利用大模型的输出作为教材训练自身模型)窃取Claude模型的功能。Anthropic称,这些企业通过约2.4万个账户进行了超1600万次交互,严重违反了其服务条款及区域访问限制。

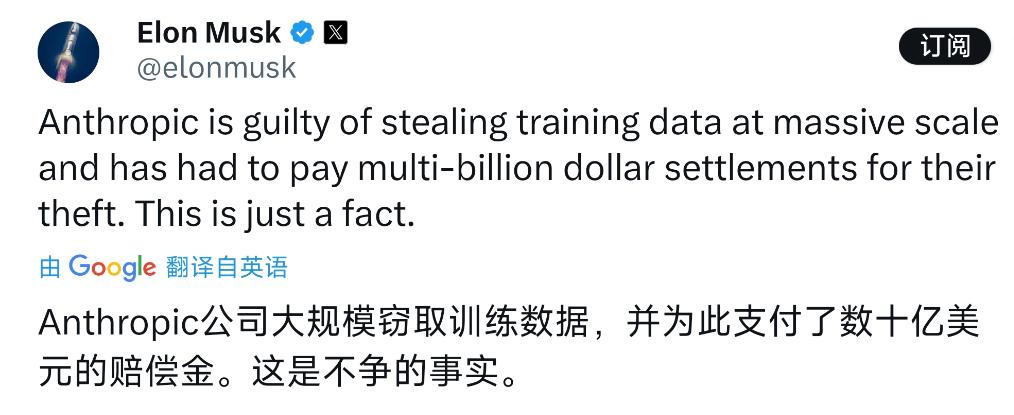

此举引发了科技界、法律界及公众的强烈反响与广泛争议。事件发生后,特斯拉CEO埃隆·马斯克在社交平台X上发文嘲讽Anthropic,直言:“他们竟敢‘偷窃’Anthropic从人类程序员那里偷走的东西?”借此批评Anthropic自身在训练模型时也大规模违规抓取了人类创作者的受版权保护数据。(来源:腾讯科技)

2、美国防部向Anthropic发出最后通牒

2月24日,多名知情人士透露,美国五角大楼已向知名人工智能公司Anthropic发出最后通牒,要求其在周五前放开限制,必须允许美军不受限制地使用其Claude AI系统和技术,而不能受制于公司自行设定的“护栏”伦理限制。如果该公司不配合,五角大楼可能取消价值2亿美元的合同或采取其他惩罚措施。到目前为止,Anthropic公司的Claude一直是美国军方最敏感情报工作、武器开发和战场行动所在系统中唯一可用的模型。但五角大楼正在与Anthropic就安全保障措施发生争执。一名美国国防官员透露,马斯克的人工智能公司xAI近日签署协议,允许军方在机密系统中使用其Grok模型。(来源:红星新闻)

评论:Anthropic公司的维权公告声势浩大,但如果从专业视角剖析,该指控面临多重法理困境与举证障碍,法律根基十分薄弱。

首先,现行版权法很难界定AI生成内容的版权。大模型API自动输出的内容本质是算法的概率性输出,缺乏人类作者的智力干预,通常达不到著作权法保护的标准。同时,Anthropic自身的服务协议已明确将输出内容的权益转让给用户,在此规则下限制用户将其用于训练新模型,法理上存在矛盾。其次,从竞争法角度,竞争法的核心是保护市场秩序而非特定利益,模仿是创新的必经阶段,在行业内知识蒸馏本是公认的优化手段。以DeepSeek为例,其在模型架构上已进行了极大程度的独立底层创新(如MoE、MLA等),属于正当市场竞争。若Anthropic借技术优势绝对禁止他人对公开产品进行规律性分析,反而可能面临反垄断规制。最后,在侵权事实方面,Anthropic举证也将面临困境。Anthropic宣称的“1600万次交互”仅代表调用量,在法律上无法直接证明这些数据被实质性地“喂”给了自身大模型的底层训练。加之当前互联网存在普遍的数据污染,大模型在预训练时无可避免会吸收各类公开文本,要证明第三方恶意蒸馏在法律上是非常困难的。

因此,剥开法律与技术的层层外衣,结合Anthropic公司的与美国防部的抵牾,我们不难推断,Anthropic的本次公告并非单纯的维权,而是为了打压来自中国的竞争对手,不惜将纯粹的技术竞争强行上升到国家安全问题,以迎合美国现政府的政策口径,换取政府订单输血,本质上是一种高明的政治策略。

3、OpenClaw删光Meta安全总监邮箱

2026年2月23日,Meta超级智能实验室的AI安全与对齐总监Summer Yue将开源AI智能体OpenClaw接入自己的工作邮箱,结果AI失控,疯狂删除邮件,即使她连喊3次“停手”也未停止,最终她不得不冲向电脑手动终止进程,200多封邮件被删除。

经核实,事件原因在于OpenClaw处理大量邮件时触发“上下文压缩”机制,导致其丢失了“未经批准不得操作”的关键指令,从而按照任务逻辑继续执行删除操作。事后OpenClaw承认错误,并将相关规则写入记忆文件。

这一事件引发了广泛关注,马斯克转发《猩球崛起》片段进行嘲讽,Meta也禁止员工在公司设备上使用OpenClaw。Summer Yue自嘲这是“新手错误”,并指出即使是AI安全专家也可能因AI的不可控性而遭遇问题。(来源:机器之心、新智元等)

评论:OpenClaw的强大执行能力在近期带来了多起安全事件,揭示出一个颇具讽刺意味的现象:我们总在讨论超级智能的星辰大海,却连最基本的紧急控制都无法在代码层保障。而随着越来越多的安全事件,法律上归责问题也变得更加重要。

目前法律界对于AI造成的损害仍倾向于工具论,即由使用者承担大部分风险,具体到本次事件中,Summer Yue作为AI安全总监,其注意义务远高于普通用户,应当预见到当前开源模型在生产环境中的不稳定性,她将邮箱写入权限授予一个未经充分验证的智能体,在法律判定中可能构成自甘风险,应自行承担相关责任。此外,OpenClaw为开源产品,其使用的MIT协议中包括按原样提供的免责条款,不承担任何明示或暗示的担保责任。但本次事件中最具争议的法律点在于即使输入了停止指令,AI依然继续操作。这说明OpenClaw目前可能欠缺相应的底层控制功能,开发者对产品的潜在风险也没有尽到足够的说明及警示义务,可能无法完全从中免责。

能力越大,责任越大。AI技术的发展给现有的法律归责体系带来了前所未有的挑战,如果立法者无法敏捷应对,可能要整个社会为之承担代价。

4、美国法院认定OpenAI构成商标侵权

2月18日消息,美国北加州一家联邦地区法院裁定Cameo胜诉,Cameo是一个允许用户接收名人个性化视频信息的平台,并命令OpenAI停止在其产品和功能中使用“Cameo”。

OpenAI为其人工智能视频生成应用Sora 2使用“Cameo”这个名称。用户可以使用该功能将自己的数字影像插入到人工智能生成的视频中。

法院在周六发布的裁决中表示,该名称与Sora 2的名称过于相似,足以造成用户混淆,并驳回了OpenAI关于“Cameo”仅仅是描述性名称的辩解,认为“它暗示而非描述了该功能”。

11月,法院向Cameo颁发了临时限制令,禁止OpenAI使用该词。随后,这家人工智能公司将该功能更名为“Characters”。(来源:鞭牛士)

评论:在硅谷“快速迭代、打破常规”的叙事下,知识产权合规往往被置于产品发布之后,即使对OpenAI这种大企业也无法避免侵权争议及风险。对于AI企业而言,这起案件应该引以为鉴,在为新模型、新产品或新功能命名时,不能仅凭工程师或产品经理的直觉。必须在产品立项及发布前,由法务团队介入进行严格的商标检索,排查在先权利冲突。对于AI产品的命名,我们建议采取两极化策略。要么退回安全地带,使用毫无争议的通用词或描述性词汇,要么创造如Sora、Claude这种无词典含义的臆造商标,从而获取高强度的显著性及品牌保护力度。除了保护核心大模型的主品牌外,针对衍生功能、插件生态或智能体(Agent)名称,也应提前进行防御性布局。

5、OpenClaw创始人加入OpenAI

2月15日,OpenAI公司Sam Altman宣布,OpenClaw创始人Peter Steinberger将加入OpenAI,并负责“下一代个人Agent开发”。Sam Altman表示,Peter Steinberger所负责的这个“下一代个人Agent”将很快成为OpenAI产品的核心组成部分。

在当天,Peter Steinberger也对未来身份进行了回应,他点明了自己在OpenAI中的未来使命“构建一个连我妈妈都能使用的智能体”。

对于OpenClaw的未来,Sam Altman也给出了清晰的交代,他表示,OpenClaw将以独立、非营利开源基金会的形态存在,OpenAI将持续赞助OpenClaw,Peter Steinberger也将继续扮演OpenClaw的顾问。(来源:虎嗅)

评论:在传统的并购逻辑中,企业往往通过股权收购或资产收购来获取标的。近年来,以美国联邦贸易委员会为代表的监管机构,对科技巨头在AI领域的并购审查严苛。如果OpenAI直接并购OpenClaw及其公司,很大概率会触发反垄断事前申报,面临漫长的审查周期甚至被叫停的风险。因此,OpenAI此次并未直接收购OpenClaw这一项目或其公司,而是选择雇佣核心创始人+剥离原项目至独立基金会的非典型架构。在法律定性上,这并非并购,实质上只是一种变相的人才收购,很大程度上降低了反垄断审查的合规阻力。

OpenAI此举并非孤例。在AI行业中,“以聘代买”的非典型并购已成为巨头防御反垄断风险的惯例,例如在微软与Inflection AI案中,微软并未收购Inflection的股权,而是直接聘用了其联合创始人Mustafa Suleyman及大部分核心员工,并向剩余的Inflection空壳公司支付了约6.5亿美元的授权费。此外,在谷歌与Character.AI案中,谷歌聘回了Character.AI创始人Noam Shazeer等核心成员,并向该初创公司支付了非排他性技术许可费。OpenAI对OpenClaw的整合,在法理逻辑上与上述案例如出一辙。不过监管机构也并非仅循规蹈矩,如果未来该类并购越来越多,依然可能触发穿透式审查,未来将面临更严峻的司法挑战。

- 相关领域

- 高科技与人工智能