1、普通人遭AI短剧偷脸,被制成贪财好色男

一名普通人的脸居然出现在一部AI短剧里,还被塑造成贪财好色的样子。3月31日,“AI短剧 偷脸”话题登上微博热搜。

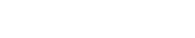

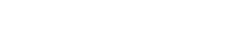

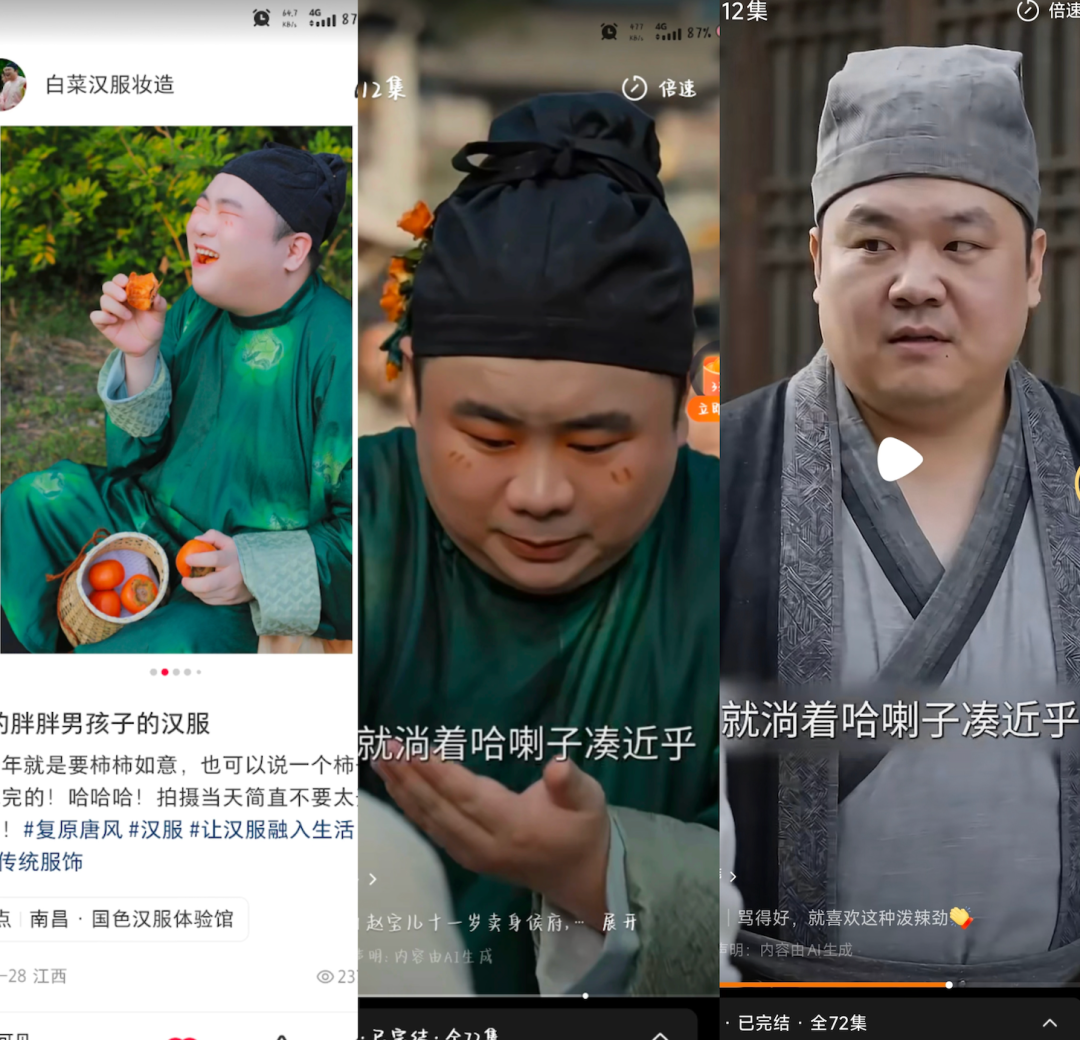

事件起始于一位ID为“白菜汉服妆造”(简称“白菜”)的用户在社交平台发帖称,“红果短剧《桃花簪》未经允许,擅自使用了我之前拍过的照片进行AI(处理),衣服、配饰、妆容等,(与真人)都一模一样。短剧把我塑造成一个贪财好色的人,真的很无语。”

白菜向第一财经记者回应称:目前他已向红果短剧平台进行申诉,也注意到相关页面人物形象已进行调整。

截至发稿,红果短剧方面暂未发表回应。记者搜索发现,红果短剧平台上相关剧集里涉及白菜的人物形象已进行调整更换,但同样上线《桃花簪》的其他短剧平台如百度短剧等页面上,相关人物形象暂未发生调整。

对于处理举措,红果短剧客服对外回应称:创作者可以通过邮箱投稿,专人对接后即可上架短剧,侵权问题目前只能通过客户端上传证据申诉。(来源:第一财经)

2、中广联演员委员会就AI换脸合成发声明

当前,AI换脸合成、声纹克隆复刻、影视素材任意篡改、魔改、擅自抓取演员影像声频用于AI模型训练等侵权行为频发,严重侵害演艺从业人员合法权益,扰乱视听行业正常秩序。为规范行业发展、严守法律底线、强化权益保护,中国广播电视社会组织联合会演员委员会现发布严正声明。(来源:财联社)

评论:AI短剧行业在近期内迎来了爆发式的发展,但也带来了诸多的问题,肖像权、声音权侵权问题首当其冲。《民法典》第1019条明确规定,任何组织或者个人不得利用信息技术手段伪造等方式侵害他人的肖像权,第1023条同样规定保护他人声音权。如果短剧制作方未经授权,擅自利用AI技术抓取其照片并生成高度相似的数字形象用于商业短剧。无论该形象是直接贴图还是AI重新渲染生成,只要具备可识别性,就构成了对原权利人肖像权的直接侵犯。此外,案件中当事人被塑造成贪财好色的反面角色。当AI换脸与特定负面人设结合,导致公众对被换脸者的社会评价降低时,不仅侵犯了肖像权,更触犯了名誉权。此类侵权往往会导致精神损害赔偿的诉求,本身具有很高的法律风险。

上周北京互联网法院刚做出针对迪丽热巴肖像侵权的短剧判决,本周就发生了AI“偷脸”及集体抗议事件,这表明AI短剧的人格权侵权问题已经非常严重,所有制作方都应该予以特别关注。我们建议制作方应建立严格的入库审查机制,在引入AI生成的面部形象、声音克隆或场景素材时,必须要求提供方出具明确的授权链条证明。在短剧制作过程中,切勿故意使用AI生成神似某明星或知名博主的形象,这种碰瓷行为极易被认定为不正当竞争或肖像权侵权,不仅可能直接导致短剧被平台下架,甚至可能招来侵权诉讼及行政处罚,切勿抱有侥幸心理。

3、51万行Claude Code源代码泄露

3月31日,Web3安全公司FuzzLand的实习研究员Chaofan Shou在社交平台X上披露,Anthropic旗下AI编程工具Claude Code的源代码被意外泄露,开发者可以轻松一窥甚至还原Claude Code的内部构造。数小时内,相关代码即被上传至GitHub并广泛传播,甚至已有开发者基于泄露内容完整重建了Claude Code。事件发酵后,Anthropic紧急更新npm包并移除相关文件,同时删除早期版本。但为时已晚。

每经记者就此事向Anthropic求证,该公司回应称:“今日早些时候,Claude Code的一次发布中包含了部分内部源代码。此次事件未涉及或暴露任何敏感的客户数据或凭证。这是由于人为错误导致的发布打包问题,而非安全漏洞。我们正在推出措施,以防止类似情况再次发生。”

这已经是Anthropic一周内发生的第二次重大泄露事件。3月26日,该公司刚刚因CMS(内容管理系统)配置错误,泄露了名为Claude Mythos的模型信息和约3000份未公开的资产。更早之前,Claude Code在2025年2月和2024年12月也分别出现过源码和系统提示词泄露问题。频繁发生的“人为失误”,正持续侵蚀市场对其安全能力的信任。(来源:每日经济新闻)

评论:Claude Code作为顶级AI编程工具,其代码库包含了架构设计、上下文处理逻辑、工具调用机制以及系统提示词策略等内容,对于很多初创团队而言,这份源码无异于顶级武功秘籍。此次源码泄露将大幅缩短竞争对手的研发摸索周期,间接推动AI编程工具赛道的技术发展。可以预见,在极短的时间内,市场上极有可能涌现出一批底层架构与Claude Code高度相似的平替或竞品。

对于开发者和企业而言,面对这份在GitHub上唾手可得的代码,最危险的举动就是直接使用、借鉴或反编译这批代码。许多人认为既然代码已经在互联网上公开传播,就等于开源软件,可以随意使用。事实上,未经权利人明确许可的发布,不改变代码本身的受版权保护状态。任何擅自下载、复制、修改、演绎或传播泄露代码的行为,均构成对计算机软件著作权的直接侵犯。更何况,源码本身也可能包含Anthropic自身的商业秘密,对其直接使用也可能构成商业秘密侵权。近期,Anthropic必然会启动广泛的维权行动,使用这些代码的产品随时面临被平台下架、被权利人索赔巨额经济损失的风险。

Anthropic的失误固然是其内部管理的灾难,但绝不能成为其他企业非法捷径。AI企业可以借此学习其优秀的架构思想和解决问题的思路,但是必须明白看懂和抄袭之间有不可逾越的法律鸿沟。如果AI企业希望开发类似功能,必须采用严格的净室设计原则,即让接触过泄露代码的工程师只负责撰写功能需求文档,而让完全没有看过泄露代码的另一批工程师根据文档独立编写代码。保持技术洁癖,坚持独立自主研发,才能让企业实现长远发展。

4、商务部回应Meta收购Manus及企业跨国经营问题

商务部4月2日举行例行新闻发布会,有记者提出中方对Meta收购Manus会采取哪些措施以及企业跨国经营的相关问题,商务部新闻发言人何亚东对此回应说,中国政府支持企业根据需要开展跨国经营与技术合作,相关行为需遵守中国法律法规,履行法定程序。(来源:澎湃新闻)

评论:从近期主管机关的多次表态来看,Meta收购Manus可能很快将迎来实质性结果。如我们之前分析,本次交易可能触及《中国禁止出口限制出口技术目录》的受限技术出口及《数据安全法》下的数据出境安全评估,主管机关已经在对本次交易进行严格的审核评估。

根据上述监管逻辑,监管机构很有可能对本次并购附加严苛的限制性条件,如数据本地化、算法独立性(Manus的核心算法不得直接转移给Meta)、要求剥离中国境内业务等。考虑到AI Agent领域的蓬勃发展,Manus对Meta的战略价值可能受到很大影响,Meta可能无法提供令监管满意的风险剥离方案,审查机关将具有较大可能依法否决该交易。

5、Meta陷AI眼镜隐私争议:AI审核员竟能看到拍摄的如厕画面

近日,福克斯新闻报道称,在肯尼亚内罗毕审核AI数据的员工,可能看到了由Meta AI智能眼镜拍摄的高度私密画面,这些视频显示了如厕等私密时刻,Meta智能眼镜的隐私争议升级。

Meta智能眼镜的AI助手可针对用户所见事物回答问题。为了让答案更准确,系统有时会依赖人工审核过的训练数据。从事AI标注工作的员工负责审核图像、视频或音频,帮助标记图像中出现的内容、识别话语,并验证AI的回答是否正确,以此让人工智能系统更好地理解其所处理的内容。

接受采访的员工表示,他们有时会审核Meta智能眼镜拍摄的视频。一位标注员告诉记者,他们能看到从客厅到身体的一切。另一名员工表示,视频中的人脸本应自动模糊处理。但模糊处理有时会失效,导致一些身份信息可见。员工们还表示,在一些片段中,他们能看到信用卡或其他敏感信息。

据欧洲新闻电视台(Euronews)报道,Meta智能眼镜拍摄的视频和图片包含银行卡信息、私密消息和聊天等敏感信息。英国数据监管机构信息专员办公室决定对此事展开调查,随后引发了在美国的诉讼。美国诉讼指控Meta存在虚假广告宣传并无视隐私法律。

诉状称,Meta的AI智能眼镜在广告中使用“专为隐私设计,由你掌控”等宣传语,可能误导用户相信其私人时刻和数据不会外泄。诉状同时指出,Meta未对此作出任何免责声明。眼镜制造商Luxottica同样因涉嫌违反消费者保护法被列为被告。

对于智能眼镜涉及的隐私问题,Meta回应称,除非用户选择将他们拍摄的内容分享给Meta或他人,否则其智能眼镜拍摄的内容会保留在用户设备上。Meta发言人在声明中表示,“当人们与Meta AI分享内容时,我们有时会像许多其他公司一样,使用承包商审核这些数据以改善用户体验。我们采取措施过滤数据以保护隐私,并防止敏感信息被审核。”(来源:红星新闻)

评论:智能眼镜、AI Pin等可穿戴设备正成为下一个风口,但Meta近期的隐私丑闻足以让多数消费者止步,毕竟没人希望看到远在肯尼亚的AI数据审核员看着自己怎么如厕。为了避免重蹈Meta的覆辙,AI硬件企业必须建立更加严苛的合规防线,其中最高级别的隐私保护是不进行上传。AI企业应当尽可能将图像识别、语音处理等敏感操作下放到设备本地完成。只有在极少数需要复杂推理的场景下,才将经过严格截取、脱敏且不可逆的特征向量发送至云端。必须上传至云端的数据,也应在离开设备前完成物理级别的匿名化,绝不能将未经脱敏的原始画面直接暴露给外包审核团队。用户信任的建立需要日积月累,而毁灭只需要一次事故,希望AI企业不要再陷入这种盲目的合规自信,否则受损的只会是整个行业。

- 相关领域

- 高科技与人工智能